Thi truongTrung lap

OpenAI habría ignorado alertas internas sobre usuario violento de ChatGPT antes de un tiroteo

Nguon: DiarioBitcoin

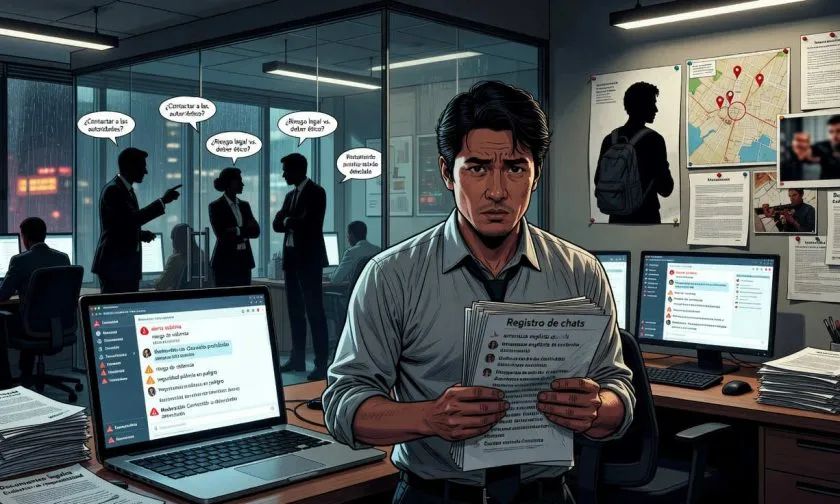

Un reciente informe ha puesto en el centro de la atención a OpenAI, revelando que la compañía habría ignorado alertas internas sobre un usuario violento de su modelo ChatGPT antes de que se produjera un tiroteo masivo en Canadá. La situación ha reavivado el debate sobre la responsabilidad de las empresas de inteligencia artificial en la detección y mitigación de comportamientos peligrosos, así como la privacidad de los usuarios en el uso de estas tecnologías. Según las fuentes, varios empleados de OpenAI expresaron su preocupación sobre el potencial uso indebido de su herramienta, pero sus advertencias no lograron generar la respuesta adecuada por parte de la dirección.

Este incidente no es un caso aislado en el creciente panorama de la inteligencia artificial. A medida que las herramientas como ChatGPT se vuelven más accesibles y potentes, también aumentan las dudas sobre cómo se gestionan los riesgos asociados. En los últimos años, ha habido numerosos debates sobre la ética en el desarrollo y uso de la inteligencia artificial, especialmente en situaciones que pueden tener repercusiones graves en la vida de las personas. Las tensiones internas en OpenAI reflejan una lucha más amplia dentro de la industria sobre cómo equilibrar la innovación con la responsabilidad social.

La importancia de este caso radica en las implicaciones que tiene para el mercado de la inteligencia artificial. Si las empresas no implementan mecanismos efectivos para identificar y actuar ante comportamientos problemáticos, podrían enfrentarse a una creciente presión regulatoria. Esto podría no solo afectar la reputación de OpenAI, sino que también podría tener un efecto dominó en otras compañías del sector, que ya operan en un entorno de vigilancia y creciente escrutinio por parte de gobiernos y la sociedad civil.

La reacción del sector ha sido mixta. Algunos expertos han señalado la necesidad urgente de establecer protocolos claros para la detección de comportamientos peligrosos entre los usuarios de inteligencia artificial. Otros, sin embargo, advierten sobre el riesgo de implementar medidas demasiado restrictivas que podrían afectar la libertad de expresión y el desarrollo de la tecnología. Este dilema ético y práctico pone de manifiesto la necesidad de un diálogo abierto y constructivo entre desarrolladores, reguladores y la sociedad en general.

De cara al futuro, es probable que este incidente sirva como un catalizador para discusiones más amplias sobre la regulación de la inteligencia artificial. Los actores del mercado tendrán que reevaluar sus políticas y prácticas para garantizar que se priorice la seguridad sin sacrificar la innovación. La vigilancia sobre el uso de herramientas de inteligencia artificial podría aumentar, y las empresas deberán estar preparadas para adaptarse a un entorno en constante cambio, donde la responsabilidad y la ética se vuelven cada vez más cruciales.

Tu phan tich cua chung toi:

Ban muon nhan tin tuc som nhat?

Theo doi kenh Telegram cua chung toi – chung toi dang tin tuc quan trong va phan tich.

Theo doi kenh