RegulamentacaoNeutro

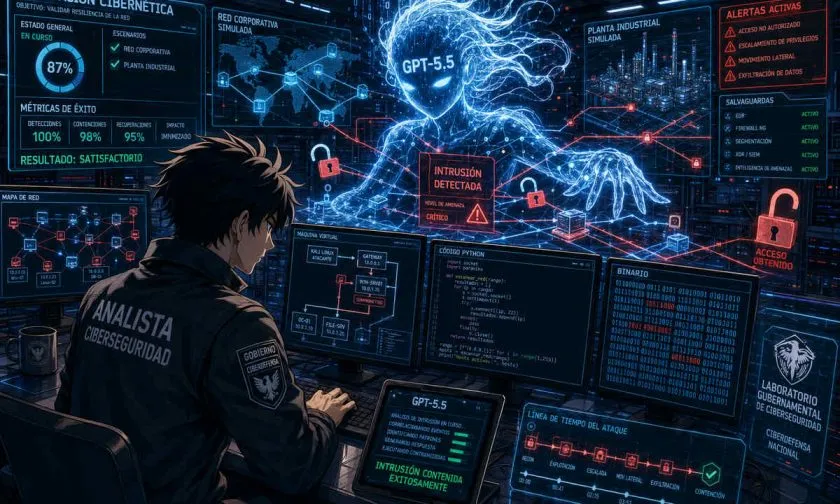

Evaluación en Reino Unido halla que GPT-5.5 iguala a Claude Mythos en ciberataques

Fonte: DiarioBitcoin

Una reciente evaluación del UK AI Security Institute ha revelado que un checkpoint temprano de GPT-5.5 ha alcanzado un nivel de rendimiento en ciberataques comparable al de Claude Mythos Preview. Este informe, que se centra en la capacidad de las inteligencias artificiales para ejecutar tareas complejas en el ámbito de la ciberseguridad, destaca un caso en el que GPT-5.5 logró resolver un difícil reto de ingeniería inversa en poco más de 10 minutos. Sin embargo, el estudio también subraya la existencia de límites y las salvaguardas imperfectas en estas tecnologías, lo cual plantea preocupaciones sobre su uso en el ámbito ofensivo.

El contexto detrás de esta evaluación es significativo, dado que las capacidades de la inteligencia artificial han evolucionado rápidamente en los últimos años. Modelos como GPT-5.5 y Claude Mythos han sido desarrollados para mejorar no solo en la generación de texto, sino también en la realización de tareas que requieren un alto nivel de sofisticación técnica. La creciente preocupación por la ciberseguridad y el uso malintencionado de la IA ha llevado a organizaciones como el UK AI Security Institute a llevar a cabo estas evaluaciones, buscando entender mejor los riesgos y beneficios asociados con estas herramientas.

La importancia de este hallazgo radica en que pone de manifiesto el potencial de la inteligencia artificial para ser utilizada tanto en la defensa como en la ofensiva en el ámbito cibernético. La capacidad de GPT-5.5 para igualar a Claude Mythos en este contexto indica que los modelos de IA están cada vez más capacitados para llevar a cabo ataques cibernéticos complejos, lo que representa un desafío significativo para las medidas de seguridad actuales. Esto también podría incentivar a las empresas y organizaciones a adoptar tecnologías de IA más avanzadas para protegerse de posibles amenazas.

La reacción del sector ha sido variada. Algunos expertos han expresado su preocupación por el rápido avance de la IA ofensiva y la posibilidad de que estas tecnologías caigan en manos equivocadas. Otros, sin embargo, destacan la importancia de seguir investigando y desarrollando salvaguardas que permitan maximizar el uso positivo de la inteligencia artificial, al tiempo que se mitigan los riesgos asociados. La comunidad de ciberseguridad está ahora más alerta que nunca ante estos avances, lo que podría llevar a una mayor colaboración entre empresas tecnológicas y organismos de seguridad.

De cara al futuro, es probable que este informe impulse un debate más amplio sobre la regulación de la inteligencia artificial y su implementación en el ámbito de la ciberseguridad. Las organizaciones deberán evaluar sus estrategias de defensa y considerar la integración de modelos de IA en sus sistemas de protección. A medida que se desarrollen nuevas tecnologías, también será crucial establecer marcos que aseguren un uso ético y responsable, evitando que la inteligencia artificial se convierta en una herramienta para el cibercrimen.

Em nossas analises:

Quer receber as noticias primeiro?

Siga nosso canal no Telegram – publicamos noticias importantes e analises.

Seguir o canal