РынокНейтрально

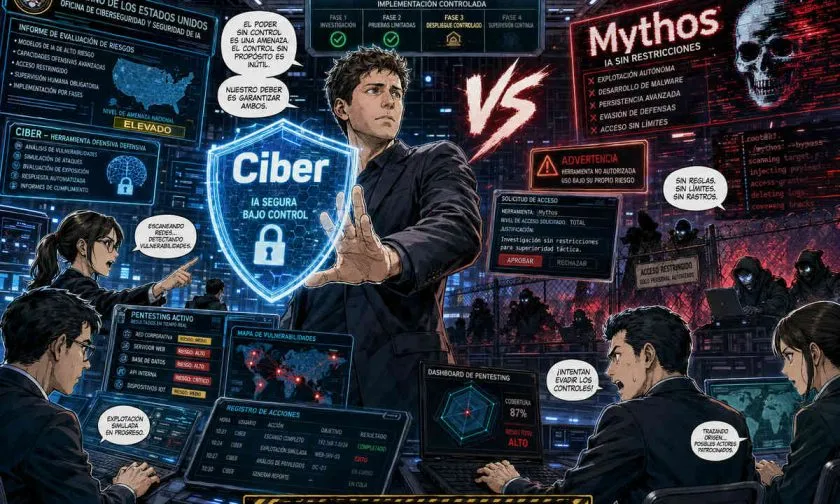

OpenAI restringe GPT-5.5 Cyber tras criticar a Anthropic por limitar Mythos

Источник: DiarioBitcoin

OpenAI ha tomado la decisión de desplegar GPT-5.5 Cyber con acceso restringido, dirigiéndose específicamente a profesionales del ámbito de la ciberseguridad. Esta medida marca un giro significativo en la política de acceso de la compañía, especialmente en contraste con las críticas que su CEO, Sam Altman, había dirigido a Anthropic por implementar restricciones similares en su herramienta Mythos. La decisión de OpenAI no solo impacta a los usuarios de su tecnología, sino que también suscita un debate más amplio sobre la ética y las implicaciones de las herramientas de inteligencia artificial en el campo de la seguridad informática.

Para entender la relevancia de esta decisión, es necesario considerar el contexto en el que se desarrolla. Anthropic, un competidor en el espacio de la inteligencia artificial, fue objeto de críticas por parte de Altman debido a su enfoque restrictivo en el acceso a Mythos, una herramienta diseñada para ayudar a identificar y mitigar vulnerabilidades en sistemas de software. La postura de OpenAI parecía inicialmente ser más abierta, pero ahora se encuentra en una encrucijada que refleja las preocupaciones sobre el uso responsable y seguro de la inteligencia artificial en la ciberseguridad.

La importancia de esta decisión para el mercado radica en la creciente necesidad de herramientas avanzadas que puedan abordar las amenazas cibernéticas en un entorno en constante evolución. La restricción del acceso a GPT-5.5 Cyber podría garantizar que solo los profesionales capacitados utilicen la herramienta, minimizando el riesgo de que caiga en manos equivocadas. Sin embargo, también plantea preguntas sobre la equidad en el acceso a la tecnología y el posible estancamiento de la innovación si solo un grupo selecto puede beneficiarse de estas capacidades.

La reacción del sector ha sido variada. Algunos expertos en ciberseguridad aplauden la medida, argumentando que limitar el acceso puede prevenir el uso indebido de la tecnología. Por otro lado, hay quienes critican la decisión, aduciendo que podría restringir el desarrollo de soluciones más efectivas en la lucha contra las ciberamenazas. Este debate refleja una tensión inherente en la comunidad tecnológica entre la seguridad y la accesibilidad, un dilema que seguramente seguirá siendo objeto de discusión en los próximos meses.

De cara al futuro, la decisión de OpenAI podría establecer un precedente en la regulación del acceso a herramientas de inteligencia artificial en el ámbito de la ciberseguridad. Será fundamental observar cómo otros actores en el sector responderán a este movimiento y si adoptarán enfoques similares o si buscarán alternativas más abiertas. A medida que el paisaje de la ciberseguridad se vuelve más complejo, el equilibrio entre innovación y seguridad seguirá siendo un tema central que definirá el rumbo de la industria.

Читайте в нашей аналитике:

Хочешь узнавать новости первым?

Подписывайся на наш Telegram-канал – публикуем важные новости и аналитику.

Подписаться на канал